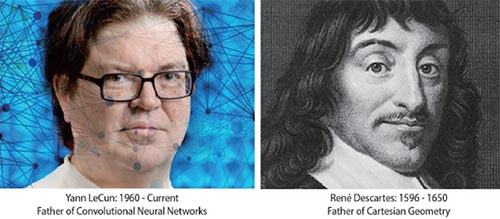

CMT 跟蹤算法

CMT 追蹤定位漢明距離大部分由WACV(WinterConference on Applications of Computer Vision)2014 例會上的《Consensus-basedMatching and Tracking of Keypoints forObject Tracking 》和CVPR 2015 例會上的《Clustering of Static - Adaptive Correspondencesfor Deformable Object Tracking 》構造 。同時在W A C V 2014 取得更好論文提綱個人獎(Best PaperAward)。由奧地德科技基地的Georg Nebehay做出。

(圖1)CMT 跟蹤算法流程框圖

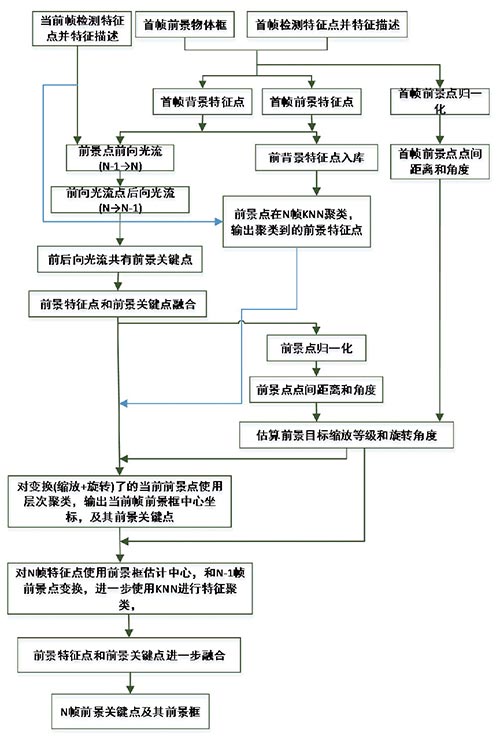

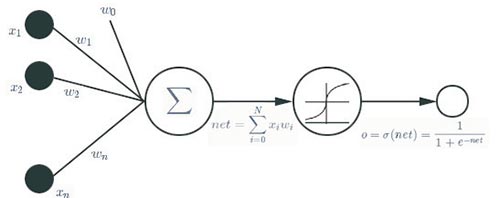

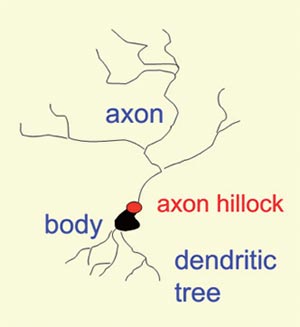

深度卷積網絡

卷積線上(Convolutional Networks)又常又稱面面周圍感覺運動神經末梢系統系統線上(Neural Networks) 也可以卷積面面周圍感覺運動神經末梢系統系統線上(Convolutional NeuralNetworks,CNN)。兩層卷積線上稱其為的長度卷積線上。卷積線上最基本上的運算單位測試卷又稱面面周圍感覺運動神經末梢系統系統元,就像文中2 所顯示。如的長度卷積線上之父Yan LeCun 提出的卷積線上非常嚴格來講不可稱其為面面周圍感覺運動神經末梢系統系統線上,同等面面周圍感覺運動神經末梢系統系統元運算單位測試卷也不再是面面周圍感覺運動神經末梢系統系統科學學必要性上的面面周圍感覺運動神經末梢系統系統元。就是到近年來已經,我們還未真明確楚人腦細胞的作業基本原理,并且在相應限度上大眾都清楚一家腦細胞皮層面面周圍感覺運動神經末梢系統系統元的作業進程。

(圖2)神經元

(圖3)大腦皮層神經元

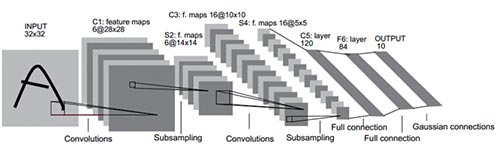

(圖4)LeNet

(圖5)DeepID2

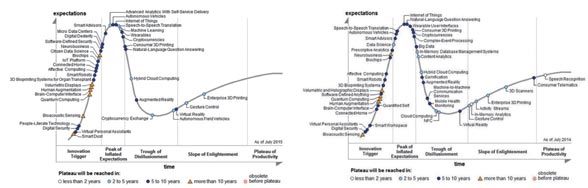

(圖6)Gartner 2015新興技術發展周期 (圖7)Gartner 2014新興技術發展周期